基于模仿学习的抓取示例-V1.2

说明

参考项目:

-

https://github.com/UBTECH-Robot/x-humanoid-training-toolchain

该代码库是 RoboMIND 数据集和天工机器人对于 Lerobot 开源框架适配的训练工具链。使用此项目,用户可以基于 Lerobot 开源框架的算法实现在 RoboMIND 数据集的使用和天工机器人的具身操作,降低开发者开发门槛,扩展 RoboMIND 数据集和天工机器人生态建设。

此指引文档在参考包基础上,解决了一些编译及配置问题。

- 适配机型:天工无疆(Pro)

- 操作系统:ubuntu 22.04

- 系统架构:x86

- 推荐GPU:Nvidia RTX 30系列及以上,显存16G及以上

- 最低系统配置:磁盘 512G ,内存16G

- 如果git等资源拉取过慢,建议使用代理

软件包

下载的软件包放到 ~/GTM/ 目录对应的位置。

GTM

├── 📂 dataset/ # vla数据集

├── 📂 soft/ # 软件包

│ ├── 📜 x-humanoid-training-toolchain.zip # vla训练包

一、基础软件

1、CUDA

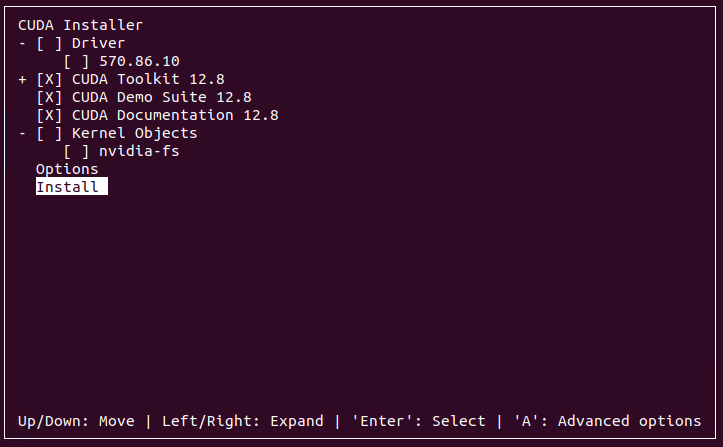

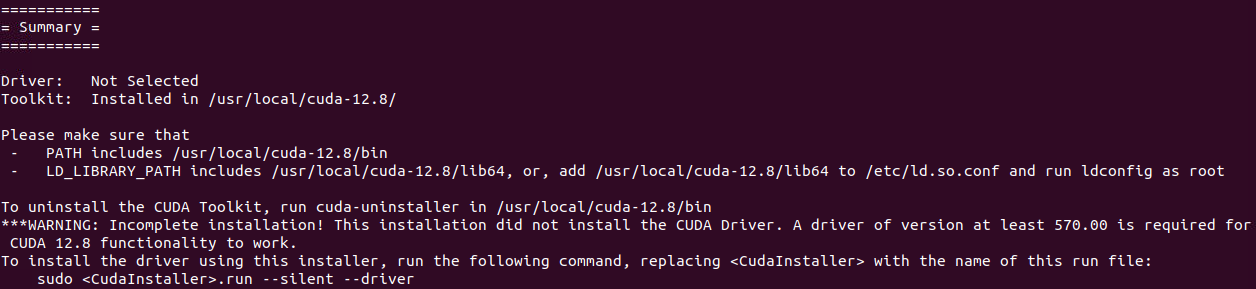

安装CUDA 。

建议正确安装最新Nvidia驱动后,使用 nvidia-smi查看驱动配套的CUDA版本,在 https://developer.nvidia.com/cuda-toolkit-archive 中选择对应的CUDA Toolkit下载。这里以12.8版本CUDA为例。

cd ~/GTM/soft

wget https://developer.download.nvidia.com/compute/cuda/12.8.0/local_installers/cuda_12.8.0_570.86.10_linux.run

sudo sh cuda_12.8.0_570.86.10_linux.run

# 设置环境变量 ~/.bashrc

echo 'export PATH=/usr/local/cuda/bin:$PATH' >> ~/.bashrc

echo 'export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH' >> ~/.bashrc

# 立即生效

source ~/.bashrc

2、Conda

安装miniconda,一直选择yes完成安装。

cd ~/GTM/soft

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

bash ./Miniconda3-latest-Linux-x86_64.sh

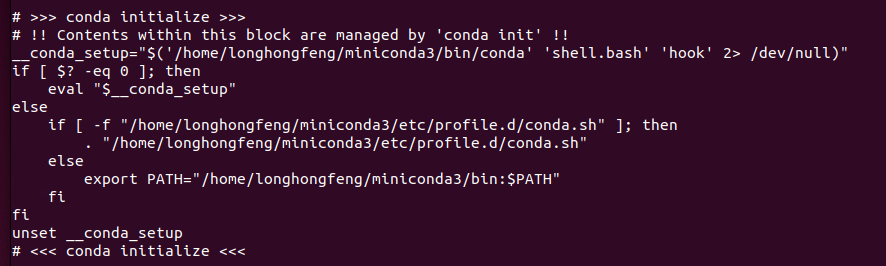

安装完毕后检查.bashrc文件内有无设置conda环境变量。

cat ~/.bashrc

二、训练及部署

1、解压代码

cd ~/GTM/soft/

unzip x-humanoid-training-toolchain.zip

2、环境安装

注意

- 链接中的cu128要与自己的CUDA配套。

- 后续命令都需要进入 conda activate env_vla 环境才能正常运行。

cd ~/GTM/soft/x-humanoid-training-toolchain

sudo apt install ffmpeg

conda create -n env_vla python=3.10

conda activate env_vla

pip install -e .

pip install -U --index-url https://mirrors.nju.edu.cn/pytorch/whl/cu128/ torchcodec

3、数据集转换

cd ~/GTM/soft/x-humanoid-training-toolchain/scripts/

./convert.sh

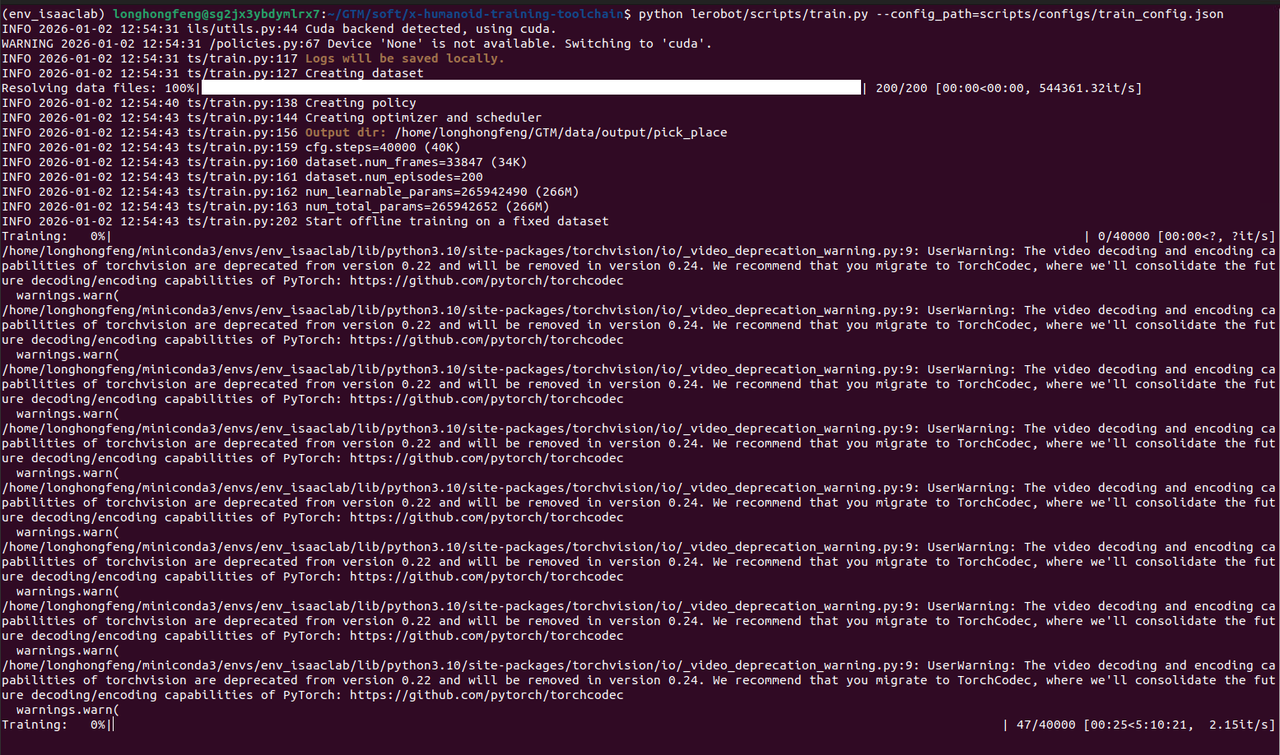

4、训练

cd ~/GTM/soft/x-humanoid-training-toolchain

sed -i "s/\[username\]/$USER/g" scripts/configs/train_config.json

python lerobot/scripts/train.py --config_path=scripts/configs/train_config.json

5、部署

~/GTM/soft/x-humanoid-training-toolchain/deployment文件夹含执行的入口,仔细阅读readme.md文件进行对应操作。- 训练好的模型在

~/GTM/data/output/pick_place/checkpoints/文件夹内。 - 在机器人的Orin板中安装当前项目依赖。运行相机程序后,在机器人半身运控模式下执行程序。注意机器人相机视野和桌面高度要与训练数据一致。